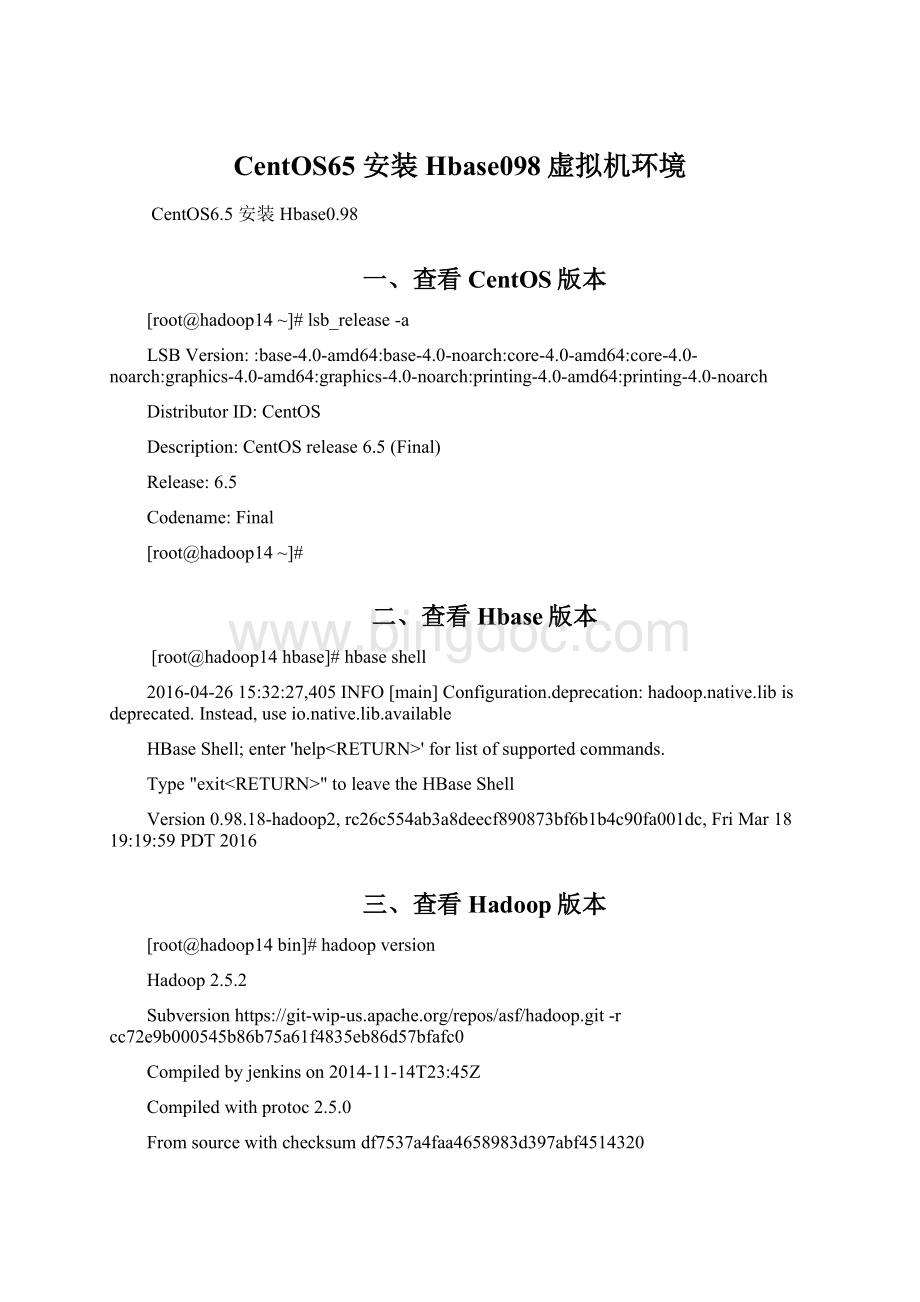

CentOS65 安装Hbase098虚拟机环境Word文档格式.docx

CentOS65 安装Hbase098虚拟机环境Word文档格式.docx

- 文档编号:8562650

- 上传时间:2023-05-11

- 格式:DOCX

- 页数:12

- 大小:66.36KB

CentOS65 安装Hbase098虚拟机环境Word文档格式.docx

《CentOS65 安装Hbase098虚拟机环境Word文档格式.docx》由会员分享,可在线阅读,更多相关《CentOS65 安装Hbase098虚拟机环境Word文档格式.docx(12页珍藏版)》请在冰点文库上搜索。

27,405INFO[main]Configuration.deprecation:

hadoop.native.libisdeprecated.Instead,useio.native.lib.available

HBaseShell;

enter'

help<

RETURN>

'

forlistofsupportedcommands.

Type"

exit<

"

toleavetheHBaseShell

Version0.98.18-hadoop2,rc26c554ab3a8deecf890873bf6b1b4c90fa001dc,FriMar1819:

19:

59PDT2016

三、查看Hadoop版本

[root@hadoop14bin]#hadoopversion

Hadoop2.5.2

Subversionhttps:

//git-wip-us.apache.org/repos/asf/hadoop.git-rcc72e9b000545b86b75a61f4835eb86d57bfafc0

Compiledbyjenkinson2014-11-14T23:

45Z

Compiledwithprotoc2.5.0

Fromsourcewithchecksumdf7537a4faa4658983d397abf4514320

Thiscommandwasrunusing/home/app/programs/hadoop/share/hadoop/common/hadoop-common-2.5.2.jar

四、查看JDK版本

[root@hadoop14bin]#java-version

javaversion"

1.7.0_51"

Java(TM)SERuntimeEnvironment(build1.7.0_51-b13)

JavaHotSpot(TM)64-BitServerVM(build24.51-b03,mixedmode)

五、版本兼容性

六、参考文档

七、查看glibc最大支持版本

[root@hadoop14hadoop]#strings/lib64/libc.so.6|grepGLIBC_

GLIBC_2.2.5

GLIBC_2.2.6

GLIBC_2.3

GLIBC_2.3.2

GLIBC_2.3.3

GLIBC_2.3.4

GLIBC_2.4

GLIBC_2.5

GLIBC_2.6

GLIBC_2.7

GLIBC_2.8

GLIBC_2.9

GLIBC_2.10

GLIBC_2.11

GLIBC_2.12

GLIBC_PRIVATE

[root@hadoop14hadoop]#ll/lib64/libc.so.6

lrwxrwxrwx.1rootroot12Jun152015/lib64/libc.so.6->

libc-2.12.so

八、安装系统

(1)配置网络,修改主机名,设置可以上网

/etc/hosts

/etc/sysconfig/network

(2)关闭防火墙

(3)安装vmtools

九、SSH免密码登录

因为Hadoop需要通过SSH登录到各个节点进行操作,我用的是root用户,每台服务器都生成公钥,再合并到authorized_keys。

(1)修改sshd_config配置

CentOS默认没有启动ssh无密登录,去掉/etc/ssh/sshd_config其中2行的注释,每台服务器都要设置。

#RSAAuthenticationyes

#PubkeyAuthenticationyes

(2)生成key

输入命令,ssh-keygen-trsa,生成key,都不输入密码,一直回车,/root就会生成.ssh文件夹,每台服务器都要设置。

(3)合并key

合并公钥到authorized_keys文件,在Master服务器,进入/root/.ssh目录,通过SSH命令合并。

catid_rsa.pub>

>

authorized_keys

sshroot@192.168.0.183cat~/.ssh/id_rsa.pub>

sshroot@192.168.0.184cat~/.ssh/id_rsa.pub>

(4)拷贝key

把Master服务器的authorized_keys、known_hosts复制到Slave服务器的/root/.ssh目录。

scpauthorized_keysknown_hostsroot@192.168.0.183:

/root/.ssh

scpauthorized_keysknown_hostsroot@192.168.0.184:

(5)检证免密登陆

sshroot@192.168.0.183、sshroot@192.168.0.184就不需要输入密码了。

十、安装JDK1.7过程

(1)创建安装目录

mkdir/usr/lib/jdk1.7

(2)上传压缩包至master并解压

tar-zxvfjdk-7u51-linux-x64.gz-C/usr/lib/jdk1.7

(3)移动JDK至相应目录

移动jdk1.7.0_51中的文件到/usr/lib/jdk1.7,并删除jdk1.7.0_51文件夹

cp-rf/usr/lib/jdk1.7/jdk1.7.0_51/*/usr/lib/jdk1.7/

rm-rf/usr/lib/jdk1.7/jdk1.7.0_51/

(3)编辑/etc/profile文件

exportJAVA_HOME=/usr/lib/jdk1.7

exportCLASSPATH=.:

$JAVA_HOME/jre/lib/rt.jar

:

$JAVA_HOME/lib/dt.jar

$JAVA_HOME/lib/tools.jar

exportPATH=$JAVA_HOME/bin:

$PATH

(4)使配置生效

source/etc/profile

同步至其它节点:

scp-r/etc/profileslave1:

/etc/profile

scp-r/etc/profileslave2:

sshroot@slave1source/etc/profile

sshroot@slave2source/etc/profile

(5)检查安装版本

java-version

sshroot@slave1java-version

sshroot@slave2java-version

(6)同步JDK至其它节点

在另两台节点上分别执行,或是直接拷贝目录。

sshroot@slave1mkdir/usr/lib/jdk1.7

sshroot@slave2mkdir/usr/lib/jdk1.7

scp-r/usr/lib/jdk1.7/slave1:

/usr/lib/

scp-r/usr/lib/jdk1.7/slave2:

十一、安装配置HADOOP

(1)下载hadoop安装包

将下载“hadoop-2.5.2.tar.gz”文件上传至到/home/hadoop目录下

(2)解压压缩包

tar-xzvfhadoop-2.5.2.tar.gz

(3)在/home/hadoop目录下创建目录

创建数据存放的文件夹,tmp、hdfs、hdfs/data、hdfs/name

mkdir-ptmphdfs/namehdfs/data

(4)添加到环境变量

将hbase添加到环境变量/etc/profile中

exportHADOOP_HOME=/home/hadoop

exportPATH=$HADOOP_HOME/bin:

$HADOOP_HOME/sbin:

sshroot@slave2source/etc/profile

(5)配置core-site.xml

vi/home/hadoop/etc/hadoop/core-site.xml

<

configuration>

<

property>

name>

fs.defaultFS<

/name>

value>

hdfs:

//192.168.0.182:

9000<

/value>

/property>

hadoop.tmp.dir<

file:

/home/hadoop/tmp<

io.file.buffer.size<

131702<

/configuration>

(6)配置hdfs-site.xml

vi/home/hadoop/etc/hadoop/hdfs-site.xml

dfs.namenode.name.dir<

/home/hadoop/hdfs/name<

dfs.datanode.data.dir<

/home/hadoop/hdfs/data<

dfs.replication<

2<

dfs.namenode.secondary.http-address<

192.168.0.182:

9001<

dfs.webhdfs.enabled<

true<

(7)配置mapred-site.xml

vi/home/hadoop/etc/hadoop/mapred-site.xml

mapreduce.framework.name<

yarn<

mapreduce.jobhistory.address<

10020<

mapreduce.jobhistory.webapp.address<

19888<

(8)配置yarn-site.xml

vi/home/hadoop/etc/hadoop/yarn-site.xml

yarn.nodemanager.aux-services<

mapreduce_shuffle<

yarn.nodemanager.auxservices.mapreduce.shuffle.class<

org.apache.hadoop.mapred.ShuffleHandler<

yarn.resourcemanager.address<

8032<

yarn.resourcemanager.scheduler.address<

8030<

yarn.resourcemanager.resource-tracker.address<

8031<

yarn.resourcemanager.admin.address<

8033<

yarn.resourcemanager.webapp.address<

8088<

yarn.nodemanager.resource.memory-mb<

768<

(9)配置hadoop-env.sh、yarn-env.sh的JAVA_HOME

vi/home/hadoop/etc/hadoop/hadoop-env.sh

vi/home/hadoop/etc/hadoop/yarn-env.sh

hadoop-env.sh、yarn-env.sh的JAVA_HOME,不设置的话,启动不了。

(10)配置slaves

vi/home/hadoop/etc/hadoop/slaves

删除默认的localhost,增加2个从节点

192.168.0.183

192.168.0.184

(11)传送Hadoop至其它节点

将配置好的Hadoop复制到各个节点对应位置上,通过scp传送,

scp-r/home/hadoopslave1:

/home/

scp-r/home/hadoopslave2:

(12)启动Hadoop

(A)在Master服务器启动hadoop,从节点会自动启动,

进入/home/hadoop/hadoop-2.7.2目录

初始化,输入命令,bin/hdfsnamenode-format

(11)全部启动sbin/start-all.sh,也可以分开sbin/start-dfs.sh、sbin/start-yarn.sh

(13)测试Hadoop

http:

50070

8088/cluster

十二、Hbase0.98安装流程

(1)复制安装包至master节点

通过ftp或是直接拷贝至master节点

tarzxvfhbase-0.98.18-hadoop2-bin.tar.gz

(3)添加到环境变量

exportHBASE_HOME=/home/hbase

exportPATH=$HBASE_HOME/bin:

(4)修改配置文件hbase-env.sh

vi/home/hbase/conf/hbase-env.sh

(5)修改配置文件hbase-site.xml

mkdir–p/home/hbase/tmp/zookeeper

hbase.rootdir<

//master:

9000/hbase<

hbase.cluster.distributed<

hbase.zookeeper.quorum<

master,slave1,slave2<

hbase.temp.dir<

/home/hbase/tmp<

hbase.zookeeper.property.dataDir<

/home/hbase/tmp/zookeeper<

(6)修改配置文件regionservers

修改regionservers,将文件内容设置为:

master

slave1

slave2

(7)传送Hbase至其它节点

scp-r/home/hbaseslave1:

scp-r/home/hbaseslave2:

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- CentOS65 安装Hbase098虚拟机环境 安装 Hbase098 虚拟机 环境

冰点文库所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰点文库所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

《d t n l》公开课教案优秀教学设计5.docx

《d t n l》公开课教案优秀教学设计5.docx