GPU加速器知识知多少.docx

GPU加速器知识知多少.docx

- 文档编号:14994213

- 上传时间:2023-06-29

- 格式:DOCX

- 页数:20

- 大小:1.18MB

GPU加速器知识知多少.docx

《GPU加速器知识知多少.docx》由会员分享,可在线阅读,更多相关《GPU加速器知识知多少.docx(20页珍藏版)》请在冰点文库上搜索。

GPU加速器知识知多少

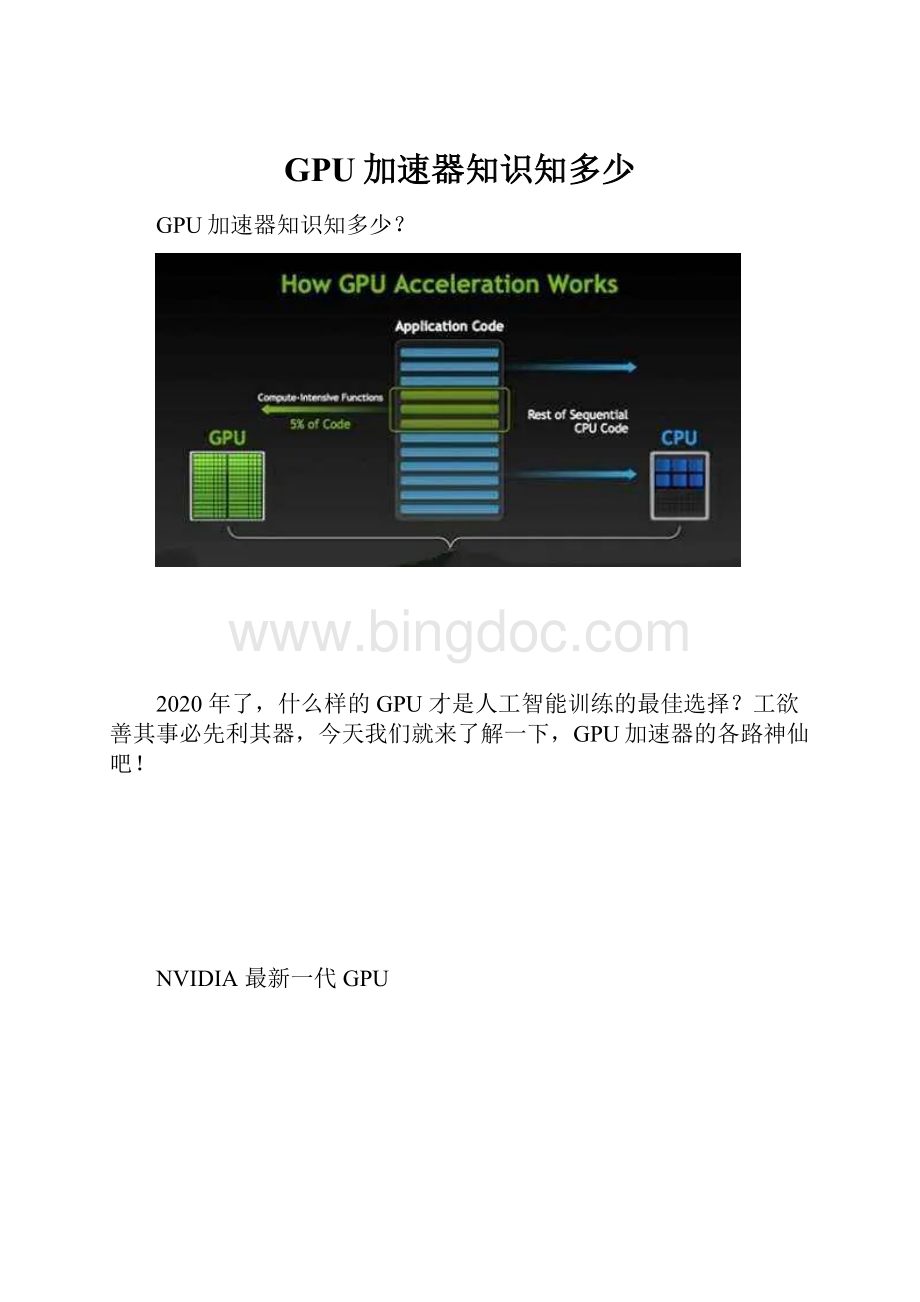

GPU加速器知识知多少?

2020年了,什么样的GPU才是人工智能训练的最佳选择?

工欲善其事必先利其器,今天我们就来了解一下,GPU加速器的各路神仙吧!

NVIDIA 最新一代GPU

NVIDIAA100TensorCoreGPU可针对AI、数据分析和高性能计算(HPC),在各种规模上实现出色的加速。

作为NVIDIA数据中心平台的引擎,A100可以高效扩展,系统中可以集成数千个 A100GPU,也可以利用NVIDIA多实例GPU(MIG)技术将每个A100划分割为七个独立的GPU实例,以加速各种规模的工作负载。

∙深度学习训练

NVIDIAA100的第三代TensorCore借助Tensor浮点运算(TF32)精度,可提供比上一代高10倍之多的性能,并且无需更改代码,更能通过自动混合精度将性能进一步提升两倍。

大型 AI模型只需在A100构成的集群上进行训练几十分钟。

∙深度学习推理

通过全系列精度(从FP32、FP16、INT8一直到INT4)加速,实现了强大的多元化用途。

MIG技术支持多个网络同时在单个A100GPU运行,从而优化计算资源的利用率。

在A100其他推理性能提升的基础上,结构化稀疏支持将性能再提升两倍。

∙高性能计算

A100引入了双精度TensorCores,原本在NVIDIAV100TensorCoreGPU上需要10小时的双精度模拟作业如今只要4小时就能完成。

HPC应用还可以利用A100的TensorCore,将单精度矩阵乘法运算的吞吐量提高10倍之多。

∙数据分析

搭载A100的加速服务器可以提供必要的计算能力,并利用第三代NVLink和NVSwitch1.6TB/s的显存带宽和可扩展性,妥善应对这些庞大的工作负载。

∙企业级利用率

A100的多实例GPU(MIG)功能使GPU加速的基础架构利用率大幅提升,达到前所未有的水平。

技术参数

*采用稀疏技术

构建数据中心必备的 GPU

从语音识别到训练虚拟个人助理和教会自动驾驶汽车自动驾驶,从天气预报到发现药物和发现新能源,数据科学家们正利用人工智能解决日益复杂的挑战,使用大型计算系统来模拟和预测我们的世界。

NVIDIA V100TensorCore是有史以来极其先进的数据中心GPU,能加快AI、高性能计算(HPC)和图形技术的发展。

其采用NVIDIAVolta架构,并带有16GB和32GB两种配置,在单个GPU中即可提供高达100个CPU的性能。

∙人工智能训练

TeslaV100拥有640个Tensor内核,是世界上第一个突破100万亿次(TFLOPS)深度学习性能障碍的GPU。

新一代NVIDIANVLink以高达300GB/s的速度连接多个V100GPU。

∙人工智能推理

NVIDIAV100GPU可提供比CPU服务器高30倍的推理性能。

∙高性能计算(HPC)

通过在一个统一架构内搭配使用NVIDIACUDA内核和Tensor内核,配备NVIDIAV100GPU的单台服务器可以取代数百台仅配备通用CPU的服务器来处理传统的高性能计算和人工智能工作负载。

技术参数

推理加速的神器

NVIDIATeslaT4TensorCoreGPU是世界上极其先进的推理加速器。

搭载NVIDIATuringTensor核心的T4提供革命性的多精度推理性能,以加速现代人工智能的各种应用。

T4封装在节能的小型70瓦PCIe中,可针对横向扩展服务器进行优化,并且旨在实时提供极其先进的推理。

∙极具突破性的推理性能

NVIDIAT4引入革命性的TuringTensor核心技术,具备人工智能推理的多精度计算性能。

从FP32到FP16再到INT8,以及INT4精度,T4的性能比CPU高出40倍。

∙先进的实时推理

NVIDIAT4可提供优于40倍的低延时高吞吐量,进而可以实时满足更多的请求。

∙视频转码性能

NVIDIAT4专用的硬件转码引擎将解码性能提升至上一代GPU的两倍。

T4可以解码多达38个全高清视频流。

技术参数

适用于桌面的个人工作站

一台DGX工作站就可以提供相当于400个CPU的计算能力,以低功耗、水冷静音而著称。

过去,硬件及软件的购置、集成和测试可能就要花一个月或更长时间。

此外,优化框架、库及驱动程序还需掌握更多专业知识,付出更多努力。

这些用在系统集成和软件工程上的宝贵时间和金钱,现在可以用于训练和实验。

∙专为您办公室设计的超级计算机

为办公室及安静场所设计,噪音仅为其他工作站的十分之一。

∙更快开始使用深度学习

只需插入和接通电源,这种部署简单直观。

这个集成软硬件的解决方案可让您将更多时间专注探索发现而不是组装组件上。

∙从桌面到数据中心,显著提升工作效率

DGX工作站可以节省价值几十万元的工程时间,避免因等待开源框架的稳定版本而导致工作效率降低。

∙相较目前最快的GPU工作站提速2倍

基于4个NVIDIA V100加速器构建的工作站,同时采用了下一代NVLink以及全新Tensor核心架构等创新技术。

DGX工作站相较现今最快的GPU工作站,深度学习训练性能提升了2倍,具备480TFLOPS的水冷性能和FP16精度。

技术参数

开箱即可用的解决方案

NVIDIADGX-1通过开箱即用的解决方案。

借助DGX-1,再加上集成式NVIDIA深度学习软件堆栈,您只需开启电源,即可开始工作。

∙轻松取得工作成果

借助NVIDIADGX-1提高研究效率,简化工作流程并与团队开展协作。

∙革命性的AI性能

DGX-1凭借NVIDIAGPUCloud深度学习软件堆栈和当今流行的技术框架,将训练速度提升高达三倍。

∙投资保护

NVIDIA的企业级支持让您无需耗费时间对硬件和开源软件进行问题排查,节省调试和优化时间。

技术参数

AI 企业的必要基础设施

NVIDIADGX-2是世界上第一个2-petaFLOPS系统,配备16块极为先进的GPU,可以在单个节点训练4倍规模的模型。

与传统的x86架构相比,DGX-2训练ResNet-50的性能相当于300台配备双路英特尔至强GoldCPU服务器的性能。

∙非同一般的计算能力造就出众的训练性能

可在单一节点上训练规模扩大4倍的模型,而且其性能达到8GPU系统的10倍。

∙革命性的人工智能网络架构

NVIDIA首款2petaFLOPSGPU加速器采用的正是这种创新技术,其GPU间带宽高达2.4TB/s,性能比前代系统提升了24倍,并且问题解决速度提高了5倍。

∙将人工智能规模提升至全新水平的最快途径

凭借用于构建大型深度学习计算集群的灵活网络选项,再结合可在共享基础设施环境中改进用户和工作负载隔离的安全多租户功能。

∙始终运行的企业级人工智能基础设施

DGX-2专为RAS而打造,可以减少计划外停机时间,简化可维护性,并保持运行连续性。

技术参数

目前全球最先进的GPU系统

NVIDIADGX A100为全球首款5petaFLOPSAI系统提供超高的计算密度、性能和灵活性。

采用全球超强大的加速器NVIDIAA100TensorCoreGPU,可让企业将深度学习训练、推理和分析整合至一个易于部署的统一AI基础架构中,该基础架构具备直接联系NVIDIAAI专家的功能。

∙各种AI工作负载的通用系统

NVIDIADGXA100是适用于所有AI基础架构(包括分析、训练、推理基础架构)的通用系统。

∙

∙DGXperts:

集中获取AI专业知识

NVIDIADGXperts是一个拥有14000多位AI专业人士的全球团队,能够帮助您更大限度地提升DGX投资价值。

∙更快的加速体验

集成八块A100GPU,可针对NVIDIACUDA-X™软件和整套端到端NVIDIA数据中心解决方案进行全面优化。

∙卓越的数据中心可扩展性

NVIDIADGXA100内置MellanoxConnectX-6VPIHDRInfiniBand和以太网适配器,其双向带宽峰值为450Gb/s。

技术参数

众所周知,如果将英伟达GPU比喻成通往人工智能路上的交通工具的话,选对了方式你坐的可能就是火箭,只需要花费一小时即可完成几百个T的数据研究,选错了,那可能就是“11”路公交车。

- 配套讲稿:

如PPT文件的首页显示word图标,表示该PPT已包含配套word讲稿。双击word图标可打开word文档。

- 特殊限制:

部分文档作品中含有的国旗、国徽等图片,仅作为作品整体效果示例展示,禁止商用。设计者仅对作品中独创性部分享有著作权。

- 关 键 词:

- GPU 加速器 知识 多少

冰点文库所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

冰点文库所有资源均是用户自行上传分享,仅供网友学习交流,未经上传用户书面授权,请勿作他用。

《畜牧学概论》复习题.docx

《畜牧学概论》复习题.docx